「中国発のAIベンチャーの製品を使っている」

「AI音声入力ですべてを操作している」

ルールが整備されないまま、現場でAI利用が進んではいませんか。シャドーAIが招くリスクから、チェックリスト、情シス向けのAI対策ステップ、安全に使えるAIツールまで、リスクを制御する具体策を紐解いていきましょう。

CONTENTS

シャドーAIとは?3つのポイント

1. シャドーAIの基本概要

シャドーAIとは、会社が許可していない生成AIサービスを、従業員が業務に利用している状態です。具体的には「生成AI、プログラムコード生成AI、AI文字起こしツール、AI音声入力ツール」などが該当し、生成AI特有の「入力データが学習され、再利用される」という性質が、より深刻な事態を引き起こしています。

| カテゴリ | シャドーAIのリスク例 |

| 生成AI | 顧客情報や未発表の企画書を要約させて、入力データが学習に利用され、外部へ情報漏洩する |

| プログラムコード生成AI | ソースコードを読み込ませてバグ修正や機能追加をし、プロプライエタリ(非公開技術を使用した)コードがAIに学習される |

| AI文字起こしツール | 社外秘の会議の録音データを元に議事録を作成し、第三者のサーバーに機密性の高い音声が保存される |

| AI音声入力ツール | 機密情報が含まれる内容を個人スマホの音声入力機能を使って作成し、音声データがプラットフォーム側の改善に利用される |

2. シャドーAIの利用実態

総務省の令和7年版情報通信白書によると、約半数の企業がすでに業務で生成AIを利用しています。しかし、懸念事項として「社内情報の漏洩等のセキュリティリスク」が上位に挙げられており、不安を抱えながらも明確な対策を講じられていない企業が多いのが実態です。

| 調査対象 | 主な実態 |

| 企業全体 | 約半数が導入済みだが、セキュリティ対策は未整備なケースが多い |

| 従業員 | 約5割が未許可AIを利用。そのうち約1割が機密情報を入力した経験あり |

| 中小企業 | 約半数が「AIの活用方針」を明確に定めていない |

※ 総務省の令和7年版情報通信白書

※ コーレ株式会社 「シャドーAI」に関する調査の結果

3. シャドーAIの発生原因

AIによって業務が劇的にスピードアップします。しかし、多くの企業ではAIの導入が追いついていません。総務省の調査によると、中小企業では約半数が「AIの活用方針にを明確に定めていない」と回答しており、社員が自己判断でツールを使わざるを得ない状況が生まれています。

| 視点 | 理由と背景 |

| 従業員側の動機 | 資料作成やコード生成などの「圧倒的な業務効率化」を追求したい |

| 企業側の状況 | ガイドライン策定や正式導入といった「管理体制の遅れ」 |

| 結論(原因) | 個人の利便性と組織のルールの「ギャップ」が原因 |

シャドーAIがもたらす5大リスク

シャドーAIの怖さは、1度流出したデータが二度と消せない点にあります。社員が「より良いものを作りたい」「便利だから」と悪気なく使い始めたツールが、結果として組織を揺るがすセキュリティ事故を引き起こすケースは少なくありません。特に注意すべき5つのリスクは以下です。

| リスク | 詳細 | 想定される影響 |

|---|---|---|

| 1. 機密情報・個人情報の漏洩 | 生成AIに入力したデータが学習に利用され、外部に流出する可能性がある | 顧客情報・開発データ・財務情報などの流出、信用失墜、損害賠償 |

| 2. コンプライアンス違反 | 個人情報保護法やGDPR、業界規制、NDAに抵触する恐れがある | 損害賠償請求や取引停止の可能性 |

| 3. 著作権・知的財産権の侵害 | AI生成物が既存著作物に酷似、または自社の知財がAI学習データに混入する | 著作権侵害訴訟、特許出願の失効、競合への情報流出 |

| 4. ハルシネーションによる業務品質低下 | AIが事実に基づかない情報を生成し、それを検証せず業務に使用してしまう | 誤った意思決定、顧客への誤情報提供、企業イメージの損失 |

| 5. セキュリティ脆弱性の増大 | 未管理のAIツールがサイバー攻撃の入口となる、データの取り扱いが不透明 | マルウェア感染、不正アクセス、データの第三者利用 |

シャドーAIチェックリスト

自社のシャドーAIリスクを評価するために、以下の項目をチェックしてみましょう。該当項目が多いほど、リスクが高い状態にあります。

| 診断項目(シャドーAIの兆候) | リスクレベル |

|---|---|

| 会議で「AIに聞いたら」という言葉が漏れる | 小(私的利用が潜在している兆候) |

| 社員の作業速度が不自然に向上している | 小(未許可ツールの利用の可能性) |

| 社員が個人のメールアドレスで契約したツールを業務で使用している | 高(会社が制御不能な情報流出) |

| 生成AIの利用に関する明確なガイドラインが社内に存在しない | 高(無秩序な利用による法的リスク) |

| ガイドラインはあるが、全社員への周知・教育が不十分である | 中(形骸化による誤操作・漏洩) |

| どの社員がどのAIツールを使っているか、実態を把握できていない | 高(シャドーITによる管理の不備) |

| 機密情報と非機密情報の区分が曖昧で、社員が判断に迷う状態にある | 高(機密データの誤入力リスク) |

| AI利用に関して気軽に相談できる窓口や担当者がいない | 中(問題の早期発見・解決を阻害) |

| 業務外ドメインへの通信ログが頻発している | 高(外部ツールへの大量データ転送) |

シャドーAI対策を始める3ステップ

1. 現状把握と利用実態の可視化

現状を把握しないまま、適切な対策は打てません。まずは以下の方法で実態を調査しましょう。

| 調査の方法 | 詳細 |

|---|---|

| 匿名アンケート | 「どのAIツールを使っているか」「どの業務で使っているか」を調査。罰則を示唆せず、率直な回答を促す |

| 部門別ヒアリング | 営業・開発・総務など、部門ごとの業務特性に応じた実態を聞き取り |

| ログ解析 | プロキシサーバーやファイアウォールのログから、アクセス先サービスを確認 |

調査結果は、部門・使用ツール・利用目的・リスクレベル・対策緊急度といった観点で整理し、どこから着手すべきかを明確にします。

2. ガイドラインの策定

現状が把握できたら、AI利用に関するガイドラインを策定します。形骸化を防ぐために、禁止事項・許可事項ともに抽象的な表現ではなく具体例を示しましょう。

| 抽象的な表現 | 具体的な表現 |

|---|---|

| 機密情報を入力しないこと | 顧客名、電話番号、未公開のプレスリリース、ソースコードは入力禁止 |

| 業務に支障のない範囲で利用可 | 一般的なビジネスメールの推敲、公開情報の要約は許可 |

情報を「公開情報」「社内限」「極秘」などに分類し、各カテゴリに対するAI利用の可否をマトリクス化すると、社員にとって分かりやすい指針となります。

ガイドラインを配布するだけでなく、「なぜこのルールが必要なのか」という背景も丁寧に説明することが重要です。AIの技術やサービスは急速に進化しているため、半年に一度など定期的な見直しも行います。

3. セキュリティツールの導入

ガイドラインや教育だけでは、意図しない利用を完全に防ぐことはできません。ルールを補完する形で、セキュリティツールの導入を検討しましょう。具体的には以下のようなツールが役立ちます。

| ツール | 機能 | 活用例 |

|---|---|---|

| CASB | クラウドサービスの利用状況を可視化・制御 | 未許可のAIサービスへのアクセスをブロック、または警告を表示 |

| SWG | Webトラフィックを監視・制御 | 特定のAIサイトへのアクセスを制限、利用ログを記録 |

| DLP | 機密情報の外部送信を検知・遮断 | 特定パターンを含むデータの送信をブロック |

ツール導入にはコストがかかりますが、情報漏洩が発生した場合の損害賠償や信用失墜と比較すれば、企業の資産と信頼を守るための必要な投資といえます。

AI導入の成功事例2選

シャドーAIを防ぐ最も効果的な方法は、安全なAIツールを会社が提供することです。実際にシャドーAIのリスクを克服し、安全なAI活用環境を構築した企業の事例を紹介します。

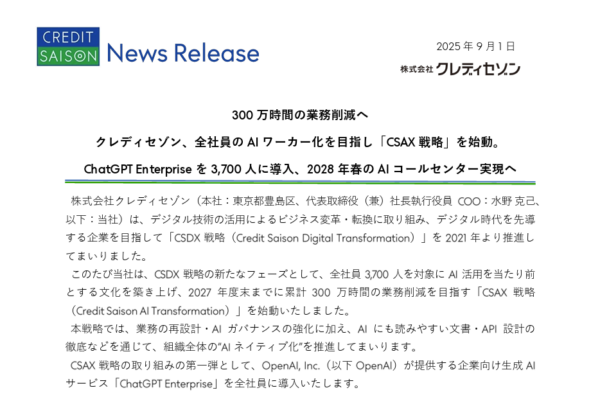

CASE1. 全社員の「AIワーカー化」を推進

全社員がAIを使いこなす戦略を掲げ、法人向けプランである「ChatGPT Enterprise」を一括導入した事例です。情報の安全性を確保しながら日常業務でAIを活用できる環境を整え、組織全体の生産性向上とAI活用スキルの底上げを推進しています。

| 施策のポイント | 具体的な成果 |

| 法人プランの全社導入 | 学習に利用されないセキュアな環境で機密情報の保護を実現 |

| 全社横断プロジェクトでの推進 | 経営直下のCSAX戦略に基づき部署の垣根を超えた活用を加速 |

| 専用コミュニティの運営 | 成功プロンプトを共有し部署を超えた知見の横展開 |

導入わずか3ヶ月で約3,300名の利用登録を達成し、一部の専門職だけでなく、全従業員がAIを武器として使いこなす組織文化への変革を成し遂げました。

※ 300万時間の業務削減へ クレディセゾン、全社員のAIワーカー化を目指し「CSAX戦略」を始動

CASE2. 独自AIで安全な活用を促進

セキュアな環境下でAIを活用できる体制を構築した事例です。外部への情報流出を防ぐ仕組みをMicrosoft Teams上で実現し、社内規定で利用を公認することで、セキュリティリスクの排除と業務の高度化を両立させています。

| 施策のポイント | 具体的な成果 |

| 独自環境の構築 | 入力データがAIの学習に利用されない閉鎖環境を実現 |

| 利用ガイドライン | 禁止事項を明確化し全従業員が迷わず使える体制を整備 |

| 広範な業務活用 | 資料要約や企画立案の補助など多岐にわたる効率化 |

導入により企画書作成や情報収集の時間が大幅に短縮され、行員がより付加価値の高い提案や顧客対応に注力できる環境が実現しています。

※ SMBCグループが独自に生み出したAIアシスタント「SMBC-GAI」開発秘話

安全に使えるおすすめの法人向けAIツール

1. 生成AI

メール作成、企画書のたたき台、議事録の要約、アイデアのブレインストーミングなど、最も幅広い業務で活用されます。シャドーAI利用の大半がこの領域で発生しているため、最優先で法人プランを導入すべき分野です。

| ツール | 特徴 | セキュリティ |

|---|---|---|

| ChatGPT Enterprise | 高精度な文章生成、幅広い業務に対応 | 入力データは学習に不使用、SOC2準拠、SSO対応 |

| Claude for Business | 長文処理に強い、丁寧な出力 | 入力データは学習に不使用、企業向けセキュリティ |

| Microsoft 365 Copilot | Word・Excel・Teamsと連携 | Microsoft 365のセキュリティ基盤上で動作 |

| Google Gemini for Workspace | Gmail・ドキュメントと連携 | Google Workspaceのデータ保護ポリシー適用 |

既存のオフィスツールとの連携を重視するなら、Microsoft 365 CopilotやGemini for Workspaceが効率的です。独立した高性能AIを求めるなら、ChatGPT EnterpriseやClaude for Businessが選択肢になります。

2. 議事録・文字起こしAI

会議の録音データには、戦略、人事、顧客情報など機密性の高い内容が含まれることが多く、シャドーAIの中でもリスクが高い領域です。「便利だから」と個人向け無料ツールを使うケースも多いため、法人契約ツールの標準化が急務です。

| ツール | 特徴 | セキュリティ |

|---|---|---|

| Notta Business | リアルタイム文字起こし、多言語対応 | 法人向けセキュリティ、データ暗号化 |

| LINE WORKS AiNote | 日本語認識精度が高い | 国内データセンター、企業向け管理機能 |

| Microsoft Teams Premium | Teams会議の自動文字起こし・要約 | Microsoft 365のセキュリティ基盤 |

すでにMicrosoft Teamsを利用している企業であれば、Teams Premiumへのアップグレードが最もスムーズな選択肢です。

3. コード生成・開発支援AI

開発部門でのシャドーAI利用は、自社のソースコード漏洩に直結します。エンジニアは生産性向上のためにAIツールを積極的に使いたがる傾向があるため、安全な環境を早期に整える必要があります。

| ツール | 特徴 | セキュリティ |

|---|---|---|

| GitHub Copilot Business | コード補完、関数生成、チャット、組織的な開発支援に強み | ビジネスプランならコードは学習に不使用、SOC2準拠 |

| Amazon Q Developer | AWS特化のサポート、インシデント調査、脆弱性検出、レガシーコードのアップグレード | 有料プランならコードは学習に不使用 |

開発チームには機能の限られた無料プランではなく、有償のプランを支給しましょう。

4. 翻訳AIツール

グローバル展開している企業では、翻訳ツールの法人契約を全社標準とすることで、リスクを大幅に低減できます。

| ツール | 特徴 | セキュリティ |

|---|---|---|

| みらい翻訳 | 日本語に強い、専門用語対応 | 国内サーバー運用、データ二次利用なし、官公庁導入実績あり |

| DeepL Pro | 高精度な翻訳、自然な表現 | テキストはサーバーに保存されない、ISO27001認証 |

5. シャドー AIでよくある質問

──セキュリティリスクが高いので禁止にしたい

生成AIへのアクセスを一律ブロックすると、社員は個人のスマートフォンや私物PCを使って生成AIを利用し始めます。これが「シャドーAIの地下化」です。

私物端末経由になると、会社側では何も把握ができずブラックボックス化します。さらに、生成結果を社内PCにメール転送するなど、新たなセキュリティホールを生む原因にもなります。

最も効果的なリスクコントロールは、適切な管理下で安全な利用環境を用意することです。禁止ではなく、安全な選択肢を提供する方がリスクは低減します。

──個人スマホでの隠れ利用を防ぐ方法は?

個人のスマートフォンを取り上げることはできません。MDM(モバイルデバイス管理)ツールで社内Wi-Fiへの私物端末接続を制御する方法がありますが、4G/5G回線を使われると限界があります。効果があるのは会社が用意したAIの方が便利で高機能であるという状況を作ることです。

効果的なAI環境

- 無料版より高性能な法人プランを提供

- 社内データを安全に参照できるRAG環境を構築

- 申請不要ですぐ使える手軽さを確保

公認の便利なAI環境があれば、社員がわざわざリスクを冒して個人の無料アカウントを使う理由がなくなります。

──社員への教育はどのように進めればよいですか?

ガイドラインを配布するだけでなく、継続した教育と安心して相談できる体制作りが重要です。

効果的な教育施策

- 全従業員対象の研修を年1〜2回実施

- 他社の情報漏洩事例や社内のヒヤリハット事例を具体的に共有

- 迷ったときの相談窓口を設置

社員を監視対象ではなく、一緒にリスクを管理するパートナーとして捉えましょう。